OpenClaw Guide: Alles über den autonomen KI-Agenten für Self-Hosting und lokale LLMs

Die Entwicklung künstlicher Intelligenz erreicht mit autonomen Agenten eine neue Evolutionsstufe. Während herkömmliche Chatbots lediglich auf Eingaben reagieren, verfolgt OpenClaw (ehemals bekannt als ClawdBot oder MoltBot) einen proaktiven Ansatz. Das Open-Source-Framework ermöglicht es, KI-Agenten zu erschaffen, die komplexe Aufgaben selbstständig planen, analysieren und ausführen. Besonders für Unternehmen und datenschutzbewusste Anwender ist die Fähigkeit zum Self-Hosting und der Betrieb mit lokalen Large Language Models (LLMs) von zentraler Bedeutung. Dies wirft jedoch kritische Fragen bezüglich der IT-Sicherheit und der Kontrolle über autonome Prozesse auf. In diesem Guide beleuchten wir die technische Architektur von OpenClaw, erläutern die Einrichtung in einer lokalen Infrastruktur und analysieren, welche Chancen und Risiken der Einsatz dieser „Reasoning-Loops“ für die betriebliche Praxis und den Datenschutz mit sich bringt.

Architektur und Funktionsweise: Der Reasoning-Loop von OpenClaw

Der technologische Kern von OpenClaw unterscheidet sich grundlegend von klassischen, zustandslosen KI-Anwendungen. Während ein Standard-LLM lediglich das nächste Token vorhersagt, nutzt OpenClaw eine KI-Architektur, die auf einem sogenannten Reasoning-Loop basiert. Dieser Zyklus besteht aus den Phasen Analyse, Planung und Ausführung. Der Agent erhält ein Ziel, zerlegt dieses in Teilaufgaben und entscheidet eigenständig, welche Werkzeuge (Skills) er zur Lösung benötigt.

Ein wesentliches Merkmal dieses Frameworks ist das modulare Skills-System. Hierbei kann der Agent auf verschiedene Schnittstellen zugreifen, um beispielsweise E-Mails zu lesen, Web-Recherchen durchzuführen oder Code in einer geschützten Umgebung auszuführen. Laut dem Glossar von Never Code Alone ist diese Erweiterbarkeit der Schlüssel zur Automatisierung komplexer Geschäftsprozesse. Die Integration erfolgt häufig über Messaging-Dienste wie Telegram oder Discord, über die der Nutzer mit dem Agenten interagiert. Im Gegensatz zu statischen Systemen „denkt“ der Agent in einer Schleife: Er bewertet das Ergebnis einer Aktion und passt seinen nächsten Schritt entsprechend an, bis das definierte Ziel erreicht ist.

Self-Hosting und lokale LLMs: Voraussetzungen für den Betrieb

Für Unternehmen, die den strengen Anforderungen der DSGVO unterliegen, ist die Cloud-Nutzung von KI-Modellen oft mit rechtlichen Hürden verbunden. OpenClaw bietet hier eine Lösung durch Self-Hosting. Anstatt Daten an externe Server (z. B. OpenAI oder Anthropic) zu senden, verbleiben alle Informationen innerhalb der eigenen Infrastruktur.

Die technischen Voraussetzungen für ein lokales Deployment sind jedoch anspruchsvoll. Für einen performanten Betrieb sind folgende Hardware-Anforderungen zu beachten:

- GPU: Eine Grafikkarte mit ausreichend Video-RAM (VRAM), idealerweise ab 12 GB aufwärts, um Modelle wie Llama 3 oder Mistral effizient zu betreiben.

- Arbeitsspeicher: Mindestens 16 GB bis 32 GB RAM für das Hosting der Anwendungslogik und der Vektordatenbank.

- Speicherplatz: Schnelle SSDs für den schnellen Zugriff auf Modellgewichte.

Die Anbindung lokaler Modelle erfolgt zumeist über Ollama, eine Software, die LLMs lokal bereitstellt und über eine API zugänglich macht. Ein kritischer Aspekt beim Einsatz lokaler LLMs ist das Kontextfenster. Kleinere Modelle neigen dazu, bei langen Aufgabenketten Informationen zu „vergessen“, was den Reasoning-Loop unterbrechen kann. In Fachdiskussionen, etwa auf Reddit, wird daher empfohlen, System-Prompts für lokale Setups zu verschlanken und spezialisierte, quantisierte Modelle zu nutzen, um die Rechenlast zu begrenzen. Durch die lokale Verarbeitung wird sichergestellt, dass personenbezogene Daten gemäß Art. 4 Nr. 1 DSGVO den Herrschaftsbereich des Verantwortlichen nicht verlassen, was die Compliance erheblich vereinfacht. Eine detaillierte Anleitung zur Installation auf virtuellen Servern bietet zudem der Guide von Contabo.

OpenClaw im Vergleich: Autonomie vs. strukturierte Workflows

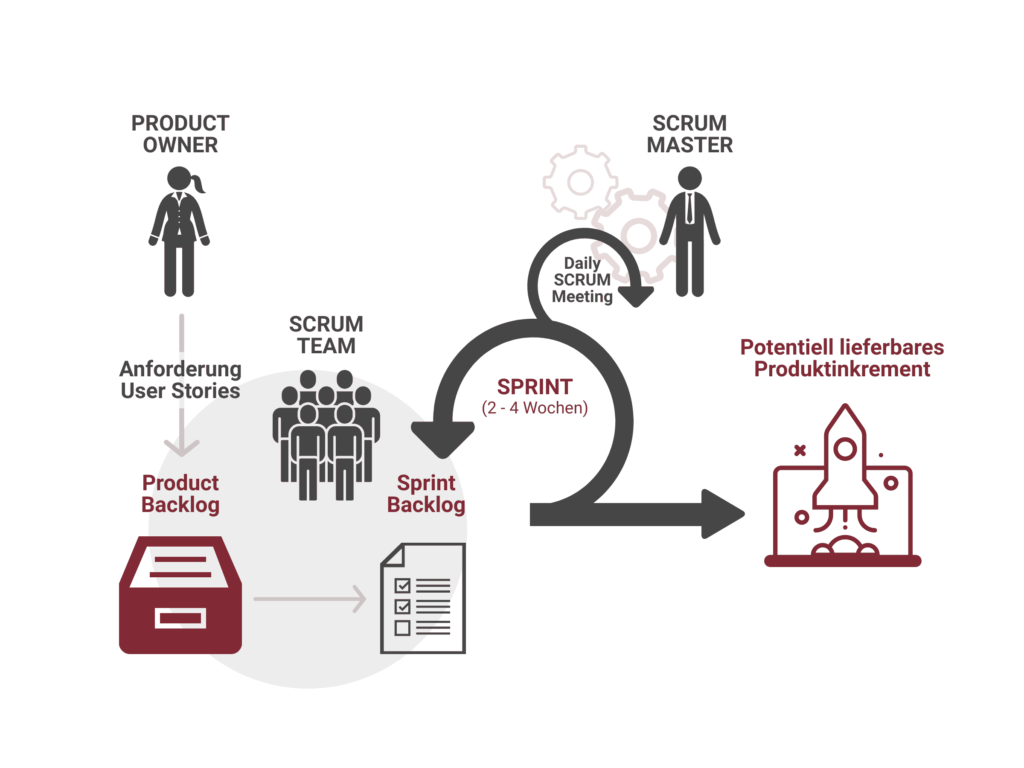

Die Abgrenzung von OpenClaw zu herkömmlichen Automatisierungslösungen wie n8n, Zapier oder Make ist für das Verständnis der betrieblichen Einsatzmöglichkeiten essenziell. Während klassische Tools auf starren „If-This-Then-That“-Logiken (Wenn-dann-Abfolgen) basieren, agiert OpenClaw als agentische KI.

In einer strukturierten Workflow-Automatisierung muss jeder Schritt vom menschlichen Anwender im Vorfeld exakt definiert werden. Weicht ein Input vom Schema ab, bricht der Prozess in der Regel ab. OpenClaw hingegen erhält lediglich ein Ziel (Objective). Der Agent nutzt seinen Reasoning-Loop, um eigenständig zu entscheiden, welche Werkzeuge (Skills) in welcher Reihenfolge notwendig sind, um dieses Ziel zu erreichen.

Diese maximale Autonomie bietet erhebliche Vorteile bei unstrukturierten Aufgaben, etwa der Recherche und Zusammenfassung von Dokumenten aus unterschiedlichen Quellen oder der Fehleranalyse in komplexen IT-Systemen. Für die betriebliche Praxis bedeutet dies jedoch auch eine Abkehr von der vollständigen Vorhersehbarkeit. Während ein n8n-Workflow deterministisch ist, bleibt der Weg, den ein autonomer Agent wählt, variabel. Unternehmen müssen daher abwägen: Wo ist Prozessstabilität (strukturierte Workflows) wichtiger als Flexibilität (KI-Agenten)? In hochregulierten Bereichen ist die Kombination beider Welten sinnvoll, bei der OpenClaw lediglich Teilaufgaben innerhalb eines festen Rahmens übernimmt.

Sicherheit und Datenschutz: Risiken beim Einsatz autonomer Agenten

Der Einsatz autonomer Systeme wie OpenClaw stellt neue Anforderungen an die IT-Sicherheit und die Compliance. Ein kritischer Punkt ist der Code-Execution-Modus. Damit der Agent Aufgaben wie Datenanalysen oder Dateikonvertierungen durchführen kann, muss er in der Lage sein, Programmcode zu schreiben und auszuführen. Ohne eine strikte Isolierung in einer Sandbox (einer abgeschotteten Laufzeitumgebung) besteht die Gefahr, dass die KI unbeabsichtigt Systemressourcen beschädigt oder Sicherheitslücken im lokalen Netzwerk ausnutzt.

Aus Sicht des Datenschutzes bietet das Self-Hosting einen entscheidenden Vorteil: Personenbezogene Daten verlassen die eigene Infrastruktur nicht, sofern ein lokales LLM genutzt wird. Dennoch müssen Verantwortliche die DSGVO-Konformität sicherstellen. Gemäß Art. 25 DSGVO (Datenschutz durch Technikgestaltung) muss gewährleistet sein, dass der Agent nur Zugriff auf die Daten erhält, die für die jeweilige Aufgabe zwingend erforderlich sind.

Für den Betriebsrat ist insbesondere die Mitbestimmung nach § 87 Abs. 1 Nr. 6 BetrVG relevant. Da autonome Agenten theoretisch Arbeitsverhalten und Leistung protokollieren oder beeinflussen können, ist eine präzise Betriebsvereinbarung zur Nutzung von KI-Agenten unumgänglich. Kritiker warnen zudem vor dem Risiko der Shadow AI, wenn Fachabteilungen solche Agenten ohne Abstimmung mit der IT-Abteilung auf lokalen Workstations betreiben. Eine unkontrollierte Dynamik, bei der ein Agent eigenständig E-Mails versendet oder API-Aufrufe tätigt, erfordert strikte Leitplanken (Guardrails) und regelmäßige Audits der Protokolldateien.

Fazit: Die Zukunft lokaler KI-Agenten in der Arbeitswelt

OpenClaw markiert den Übergang von assistierender KI zu operativ handelnden Systemen. Das Framework beweist, dass autonome Agenten keine Cloud-Abonnements erfordern, sondern sicher und souverän in der eigenen Infrastruktur betrieben werden können. Die Stärke von OpenClaw liegt in der Bearbeitung komplexer, sich verändernder Aufgabenstellungen, die über einfache Skripte hinausgehen.

Für Unternehmen empfiehlt sich eine schrittweise Implementierung. Anstatt dem Agenten sofort weitreichende Schreibrechte in kritischen Systemen einzuräumen, sollten zunächst Lese- und Analyseaufgaben im Fokus stehen. Das Konzept des Human-in-the-Loop bleibt dabei zentral: Kritische Entscheidungen oder die finale Freigabe von durch die KI erzeugten Ergebnissen müssen weiterhin durch einen Menschen erfolgen.

Langfristig werden lokale KI-Agenten wie OpenClaw die Effizienz in der Verwaltung und IT signifikant steigern. Sie entlasten Beschäftigte von repetitiven Recherche- und Koordinationsaufgaben. Die Voraussetzung für einen Erfolg ist jedoch nicht nur die technische Beherrschung der LLM-Infrastruktur, sondern auch ein klarer rechtlicher Rahmen und eine transparente Kommunikation gegenüber der Belegschaft über die Fähigkeiten und Grenzen der eingesetzten Technologie.

Weiterführende Quellen

-

Was ist OpenClaw? Guide für selbst gehostete KI-Agenten (Contabo)

https://contabo.com/blog/de/was-ist-openclaw/

Umfassender Guide zu den Funktionen von OpenClaw und Tipps für das Deployment auf virtuellen Servern. -

Open Claw (ehemals Clawdbot): Der autonome KI-Assistent (Bakedwith)

https://www.bakedwith.com/blog/open-claw-ehemals-clawdbot

Details zur Namenshistorie, Installation und praktischen Anwendungsbeispielen wie E-Mail-Zusammenfassungen. -

OpenClaw – Autonomer KI-Agent (NCA)

https://nevercodealone.de/de/glossare/ki-tools-2026/openclaw

Einordnung der Software in den Kontext digitaler Qualität und Erläuterung des Skill-Systems.